Temat depozycjonowania jest poruszany dość często, chociaż osobiście uważam, że częściej mamy styczność nie z celową próbą zaszkodzenia stronie, ale z chęcią wzmocnienia pozycji podstron tworzonych przez użytkowników. Dotyczy to wpisów w katalogach, preclach, tematów na forach, ogłoszeń w znanych portalach, wizytówek w katalogach firm, a więc wszystkich tych serwisów, na których można zamieścić linka do swojej strony.

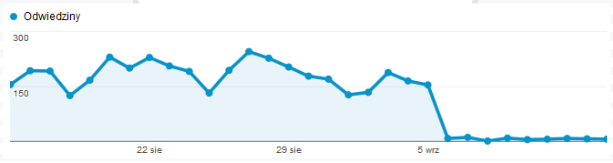

Wiele osób nie zdaje sobie nawet sprawy z tego, że nieumiejętne dopalanie swoich wpisów może dać efekt odwrotny do oczekiwanego. Zamiast podbić pozycję swojej podstrony, można zaszkodzić jej, a czasem także całemu serwisowi. Wyszukiwarka Google przyjęła rok temu agresywną strategię wobec serwisów, na których wykrywa nienaturalne linki, nakładając na nią filtry powodujące gwałtowne spadki pozycji. Wcześniej sytuacje takie, potwierdzone przez Google, należały do rzadkości.

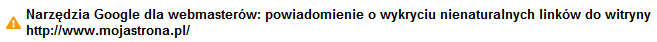

Jeśli jest to filtr ręczny, tj. nałożony przez pracownika SQT, wtedy w panelu narzędzi dla webmasterów znajdziemy powiadomienie takie jak poniżej.

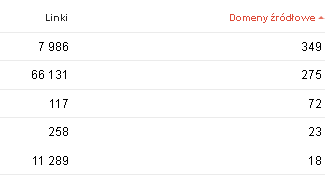

Aby zabezpieczyć się przed negatywnym wpływem linków zdobytych przez inne osoby, należy co jakiś czas zaglądać do panelu narzędzi dla webmasterów do zakładki Ruch -> Linki o Twojej witryny -> Treść najczęściej wskazywana przez linki. W pierwszej kolejności najlepiej jest posortować tabelę po ostatniej kolumnie, tj. po domenach źródłowych.

Jeśli to podstrona ma znacznie więcej domen linkujących niż strona główna, lub jedną z najczęściej linkowanych podstron jest ta, do której samemu nie zdobywało się linków, to należy się temu przyjrzeć. Wystarczy wtedy kliknąć w adres podstrony z wyjątkowo dużą liczbą domen linkujących i stamtąd pobrać listę linków prowadzących do niej.

Innymi narzędziami pomocnymi w analizie nowych linków są:

- Ahrefs z zakładką „New/Lost”;

- OSE z zakładką „Just discovered”;

- Majestic SEO z zakładką „Lost”;

- Link Alerts z linkresearchtools.com (spośród tych narzędzi korzystałam głównie z Link Detox, a narzędzie Link Alerts właśnie na nim bazuje – prezentację można obejrzeć tutaj);

- Fresh Link Finder – nie korzystałam jeszcze, ale na jednym z hangoutów oglądałam prezentację.

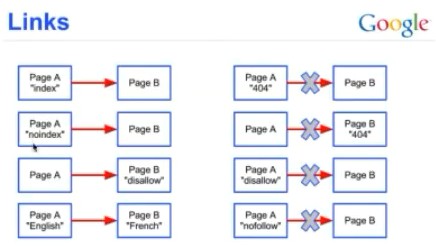

No dobrze, ale co dalej? Co, jeśli znajdziemy linki, które mogą nam zaszkodzić? Należy działać od razu, zanim Google zdąży to zauważyć? W ustaleniu strategii działania pomocna będzie poniższa grafika zaprezentowana przez Johna Muellera.

- usunięcie linkowanej podstrony – wg Google linki do nieistniejących podstron są ignorowane. Usuwając podstronę i zostawiając ją z nagłówkiem 404, powinniśmy zatem anulować wpływ linków do niej. Oczywiście jeśli linki prowadzą ze źródeł, z których łatwo je usunąć, można dodatkowo skontaktować się z osobami odpowiedzialnymi za to, np. właścicielami SWLi;

- usunięcie linków i ew. zgłoszenie pozostałych przez disavow links tool – niestety jeśli ktoś życzliwy obdaruje nas linkami do strony głównej, lub podstrony, na usunięcie której nie możemy sobie pozwolić, będzie to od nas wymagało więcej pracy. W pierwszej kolejności przez Ahrefs można sprawdzić, w jakim okresie prowadzone były takie działania – te dane akurat będą bardziej czytelne niż z GWT. Pomocne będzie także narzędzie Link Detox, które dokonuje szczegółowej analizy linków i umożliwia sortowanie po dowolnych parametrach. Na co zwrócić uwagę analizując te dane?

- nietypowe anchory – jeśli linkowane są anchory, których sami wcześniej nie używaliśmy;

- nietypowe adresy docelowe – jeśli sami promujemy adres z przedrostkiem „www”, a linki kierują do tego bez „www”;

- anchory nietypowe dla adresu docelowego – jeśli stronę główną promujemy na frazy brandowe, a podstrony na nazwy kategorii, to nietypowe jest znalezienie linków do strony głównej zawierających nazwy kategorii.

Po znalezieniu niechcianych linków, przechodzimy do próby ich usunięcia. Webmasterzy dawniej narzekali na to, że Google oczekuje od nich usunięcia linków, podczas gdy nie zawsze jest to możliwe. Dlatego korzystając ze wspomnianego wcześniej disavow links tool, możemy zgłosić w nim plik z linkami, których nie udało się usunąć – gdzie nie było danych kontaktowych, lub webmaster robił nam problemy z usunięciem linka.

Jak widać, eliminowanie szkodliwego wpływu backlinków jest obecnie znacznie prostsze niż jeszcze rok temu. W pierwszym przypadku jest to o tyle proste, że blokujemy tylko podstronę, na której raczej nam nie zależy i na tym można poprzestać W drugim przypadku niestety trzeba poświęcić temu trochę czasu, ale warto zacząć od zablokowania najważniejszych serwisów przed linkowaniem z SWLi – część z nich ma nawet opcję antylinkera i wystarczy wgrać plik, a następnie go zweryfikować. W pozostałych można mailowo poprosić o nałożenie takiej blokady, najlepiej pisząc z maila w domenie strony, aby nie było wątpliwości co do tego, że kontaktuje się w tej sprawie osoba upoważniona do reprezentowania serwisu.